Bastaron dos semanas del software avanzado de generación de imágenes de Midjourney para que algunas personas nos mostraran los peligros de un uso indebido de esta impresionante inteligencia artificial.

Hace un par de semanas, Midjourney abrió el acceso a la última generación de su software generador de imágenes versión 5, el cual cuenta con mayor potencia que los anteriores, mejorando significativamente la calidad de las personas que aparecen en sus creaciones. Menos de dos semanas después de su lanzamiento, el internet se inundó de deepfakes hiperrealistas fabricadas por la IA, que muchas personas confundieron con fotografías reales, por lo que la firma de IA se ha visto obligada a restringir las pruebas gratuitas de su servicio.

Anteriormente, Midjourney permitía que cualquier persona se registrara para usar su software a través de un servidor en Discord, ofreciendo a los usuarios la posibilidad de generar hasta 25 imágenes de forma gratuita. Posteriormente, los usuarios deben pagar una suscripción cuyo precio puede variar entre los $10 y $60 dólares mensuales. Sin embargo, el CEO y fundador de Midjourney, David Holz, anunció este martes que debido al “abuso de esta tecnología” por parte de algunas personas esto ya no será posible.

Los deepfakes virales de Midjourney

Algunas de las imágenes generadas por Midjourney 5 en sus primeros quince días reflejaron los principales riesgos y peligros de un mal uso de estas herramientas generativas de fácil acceso. Una de los deepfakes más difundidos retrata al Papa Franciso luciendo un deslumbrante abrigo blanco de Balenciaga. El tweet que difundió la imagen ya supera las 27 mil vistas.

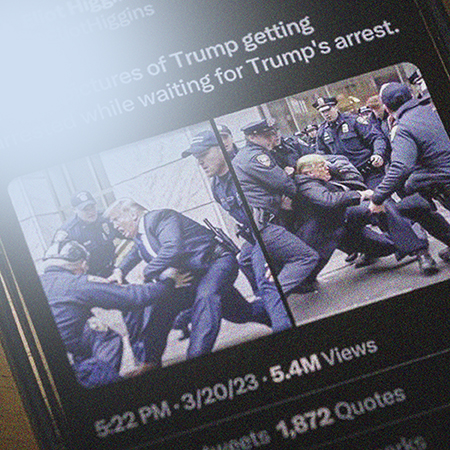

Por su parte, Elliot Higgins creó una serie de fotos falsas que muestran a Donald Trump siendo arrestado por un grupo de policías. El conjunto de imágenes muestra al expresidente de los Estados Unidos resistiéndose por la fuerza al arresto y luego huyendo de un escuadrón de policías, entre otras escenas.

El contenido generado fue compartido en Twitter por el mismo fundador del medio de periodismo de investigación Bellingcat, quien en sus primeros tweets dejó en claro que era un deepfake y solo estaba probando lo que estos generadores podían hacer. A pesar de sus aclaraciones, las imágenes se volvieron virales sin las descripciones ni el contexto que las acompañaba, provocando que muchas personas realmente creyeran que Trump había sido arrestado.

Otras polémicos deepfakes generados por MIdjourney que se volvieron virales incluyen imágenes falsas del presidente francés Emmanuel Macron participando en las protestas que actualmente están llevándose a cabo en París y una foto de Elon Musk tomado de la mano con la política estadounidense Alexandria Ocasio-Cortez.

Midjourney generó imágenes de un desastre natural que nunca pasó

Otra historia que demuestra como la inteligencia artificial puede falsificar situaciones y generar confusión en las personas es la del usuario de Reddit u/Arctic_Chilean, quien el fin de semana, publicó un conjunto de fotos generadas por la IA en el subreddit de Midjourney, señalando que ilustraban “El gran terremoto y tsunami Cascadia de 9.1 grados que azotó a los Estados Unidos en el 2001”.

La cuestión es que este catastrófico evento en realidad jamás sucedió, la inteligencia artificial fue capaz de inventar el suceso y lo más impactante es que las imágenes son lo suficientemente realistas, que a simple vista parecen verdaderas. En realidad, Cascadia es el nombre de una falla geológica submarina ubicada al noroeste del Pacífico que provocó un terremoto devastador en los 1700. A la gente de la región aún le preocupa que un desastre natural de esa escala pueda volver a ocurrir.

Es probable que la IA haya adquirido este conocimiento de alguna página de internet y mezclo información real con hechos ficticios para “alucinar” un evento que nunca ocurrió y así poder plasmarlo en una imagen fotorrealista.

A medida que la inteligencia artificial generativa siga avanzando, los generadores de imágenes se volverán aun más realistas, por lo que sin duda tanto los desarrolladores de esta tecnología como los gobiernos deben comenzar a realizar acciones para erradicar los deepfakes o estas herramientas se pueden convertir en una fuente de difamación.