A medida que la inteligencia artificial generativa avanza y surgen cada vez más aplicaciones de este tipo, urgen regulaciones que protejan los derechos de autor de los artistas cuyas obras fueron utilizadas sin su consentimiento para entrenar a estos modelos.

En muy poco tiempo, la inteligencia artificial generativa de imágenes ha dado mucho de qué hablar por su gran capacidad que potencialmente está transformando a la industria creativa. Sin embargo, esta asombrosa tecnología también ha comenzado a generar preocupación en los pintores, diseñadores, ilustradores y en el gremio artístico en general debido a lagunas en la ley que dejan desprotegida su propiedad intelectual. ¿Qué clase de implicaciones legales podrían suscitarse si no se crean leyes que regulen el uso de esta clase de herramientas?

Comienzan los problemas legales

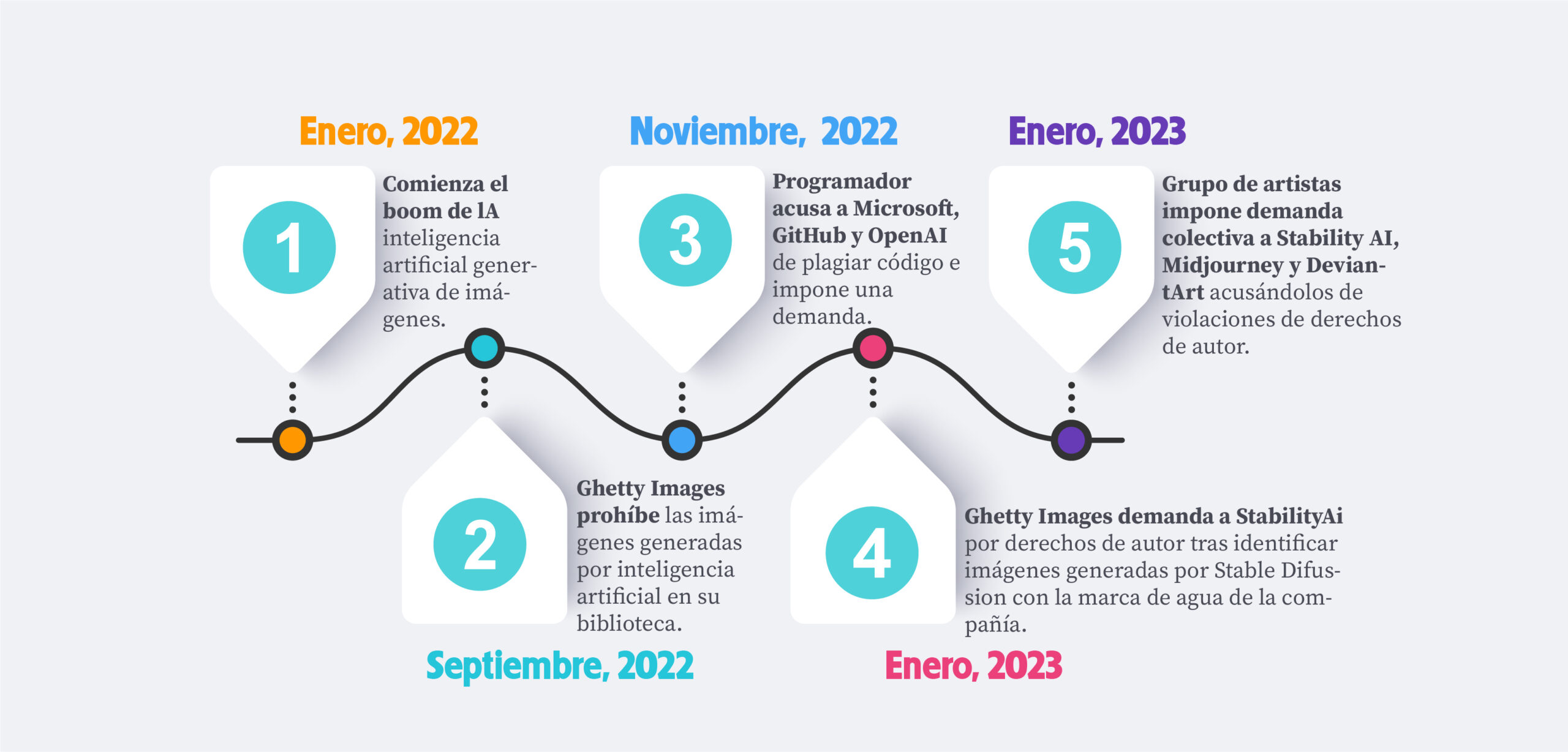

Algunos artistas ya han sentado un precedente de la batalla legal que posiblemente se desatará si no se crean leyes para regular esta tecnología.

Motivados por un programador que demandó a Microsoft, GitHub y OpenAI, por utilizar una gran cantidad de código abierto para enseñar a su IA a escribir el suyo, un grupo de artistas visuales demandaron colectivamente a Stability AI, Midjourney y DeviantArt, ante la ley de San Francisco por una presunta violación de derechos de autor.

Sarah Andersen, Kelly McKernan y Karla Ortiz, quienes impusieron la demanda alegan que las organizaciones infringieron los derechos de millones de artistas al entrenar sus herramientas de inteligencia artificial con una base de datos de millones de archivos extraídos de la web sin el consentimiento de sus propietarios o creadores.

Por otro lado, la agencia fotográfica estadounidense, Getty Images, también demandó a Stability AI por una situación similar. En un comunicado de prensa, la plataforma afirmó que la firma de inteligencia artificial procesó ilegalmente millones de imágenes de la compañía protegidas por derechos de autor para entrenar a su IA generativa.

En este caso, el uso de archivos de la biblioteca de Getty era evidente, ya que Stable Diffussion generó varios diseños que incluían una recreación distorsionada de la marca de agua que utiliza la plataforma para sus fotos. Sin embargo, la demanda apenas está en proceso.

Pese a que no sabemos el rumbo que tomarán estas demandas, las acciones legales marcan el inicio de una batalla en desarrollo entre las empresas de inteligencia artificial y los creadores de contenido.

Implicaciones legales de la inteligencia artificial generativa de imágenes

De entrada, al tener una naturaleza creativa siendo una máquina, la IA generativa da pie a debates éticos y legales. Sin embargo, pese a que hay artistas considerando que esta tecnología está plagiando sus obras o vulnerando su propiedad intelectual, la tecnología es tan joven que carece de regulaciones que protejan los derechos de los artistas.

Por otro lado, según la ley actual de propiedad intelectual de muchos países, el creador de una obra por lo general se considera el propietario de los derechos de autor. Sin embargo, cuando la IA generativa hace una imagen, no está claro quién es el dueño de la ilustración. Esta ambigüedad ha creado un vacío legal que deberá ser atacado por las autoridades legales antes de que se agrave la situación.

Hoy en día, la falta de leyes específicas para el ámbito de la IA generativa ha creado opiniones divididas entre los expertos legales. Por un lado, hay quienes consideran que si se usaron datos protegidos por derechos de autorpara entrenar a los sistemas de IA, esos sistemas deberían y seguramente pronto estarán sujetos a multas u otras sanciones.

Por otro lado, algunos abogados advierten que será difícil proceder con las demandas en contra de los modelos de IA generativa en los tribunales. Esto se debe a que es sumamente complicado demostrar que ciertas obras en específico se usaron para entrenar los sistemas de IA, ya que el contenido creado por los sistemas no necesariamente luce exactamente como algunas de las imágenes de entrenamiento.

Si bien es cierto que los mismos sistemas cuentan con términos y condiciones en los que alegan hacer todo bajo el escrutinio de la ley, al no haber regulaciones específicas para esta tecnología, tampoco hay un organismo revisando que estén cumpliendo con lo que dicen. Por eso urgen normas que garanticen la protección de los derechos de autor de los artistas, o al menos otorguen a los artistas una remuneración por el uso de su trabajo.

La respuesta de las firmas de inteligencia artificial

A pesar de las molestias y preocupaciones provocadas en los artistas, las compañías detrás de estas herramientas como Stability AI y OpenAI, argumentan que la “Ley de uso justo” de la información les permite utilizar los datos para entrenar sus sistemas con archivos licenciados.

En los Estados Unidos, este decreto en la constitución permite el uso limitado de material protegido por derechos de autor sin la necesidad de obtener el permiso del titular de los derechos. Esto se refiere a que mientras no haya sido copiado o utilizado para fines comerciales, no se considera plagio ni una violación a la ley de propiedad intelectual y puede ser utilizado legalmente.

Midjourney y DeviantArt, por su parte, se han defendido diciendo que utilizaron los archivos de los conjuntos de datos de LAION para entrenar a sus modelos. LAION es una Red Abierta de Inteligencia Artificial a Gran Escala, manejada por una organización sin fines de lucro que posee millones de imágenes de toda la web.

Lo anterior genera otro debate sobre ¿quién debería responsabilizarse en caso de una demanda, los ingenieros detrás de los sistemas o los creadores de las bases de datos? Ya que si LAION fue quien creó el conjunto de datos utilizados por los desarrolladores de la IA, entonces la supuesta violación de derechos de autor ocurrió en ese momento, no cuando éstos se usaron para entrenar a los modelos.

Por otro lado, la presión de activistas y creadores de contenido ha impulsado a algunas empresas detrás de estos modelos a crear iniciativas para mantener la buena relación con los creadores originales.

Stability AI, por ejemplo, ya permite a los artistas optar por no participar en el conjunto de datos utilizado para entrenar la próxima generación del modelo de Stable Diffusion. A través del sitio web HaveIBeenTrained.com, los propietarios de obras con derechos de autor en línea podrán solicitar la exclusión voluntaria antes de que comience la capacitación del sistema.

Por su parte, OpenAI no ofrece una alternativa de exclusión voluntaria, pero la empresa se ha asociado con organizaciones como Shutterstock para otorgar licencias parciales de sus galerías de imágenes, permitiendo que los artistas reciban una comisión cuando su obra sea utilizada para la generación de nuevo contenido. Este es el primer acuerdo de este tipo basado en una compensación a los artistas y medidas como estas podrían ayudar a disipar las dudas acerca de ¿a quién le pertenece el arte hecho por IA?

Los gobiernos comienzan a prepararse para la IA generativa, pero aún hay mucho por hacer

Sorprendentemente en Estados Unidos, donde se han suscitado los problemas legales con la IA generativa de imágenes, aún no se generan leyes que protejan el trabajo de los artistas. Sin embargo, algunos gobiernos de distintas partes del mundo ya están realizando iniciativas para gestionar el uso de estas potentes herramientas.

En el Reino Unido, están planeando modificar una ley existente para permitir el uso de texto, datos y todo tipo de archivos públicos en el internet con o sin derechos de autor. Sin embargo, esta parecería ser una ley que deja desprotegidos a los artistas y otorga mayor poder sobre sus obras a las empresas detrás de los generadores.

En China ya crearon leyes y regulaciones para controlar el uso de la IA generativa, pero están enfocadas en fomentar el uso correcto de esta tecnología, no en proteger la propiedad intelectual de los artistas.

La ley establece que los modelos deben tener ciertos filtros de contenido específicos de violencia, pornografía y más. Además, al igual que con otros servicios de Internet en el país asiático, antes de utilizar cualquier aplicación de IA generativa los usuarios deben validar su identidad.

El gobierno chino asegura que el hecho de poder ser identificado tras dar indicaciones violentas o crear imágenes sospechosas que llamen la atención, inevitablemente tiene un impacto restrictivo en el comportamiento de los usuarios en general, guiándolos hacia un buen uso de la herramienta.

Esto es solo el comienzo de la inteligencia artificial generativa y ya surgen los debates en cuanto a la legalidad de esta tecnología. Sin duda urgen regulaciones que protejan el trabajo de los artistas y garanticen usos adecuados de estos sistemas inteligentes, de tal forma que puedan convertirse en un aliado y no una amenaza para los artistas.