Personas hablan en voz alta mientras un algoritmo transforma los patrones neuronales en secuencias de números que posteriormente son convertidos en texto. La precisión fue del 97%.

En 2012 Richard Marsh, expolicía y maestro, sufrió un infarto cerebral, tras recuperar la conciencia dos días después, oyó cuando los doctores le sugerían a su esposa desconectarlo de los ventiladores artificiales. Pero él escuchaba, quería mantenerse vivo y salir de la Unidad de Cuidados Intensivos; sin embargo, no podía decirlo, pues su parálisis se lo impedía. Ante una situación como esta, sería muy útil una inteligencia artificial (IA) que lea la mente. Aunque cada vez está más cerca.

Te puede interesar: Inteligencia artificial para mejorar la experiencia del cliente

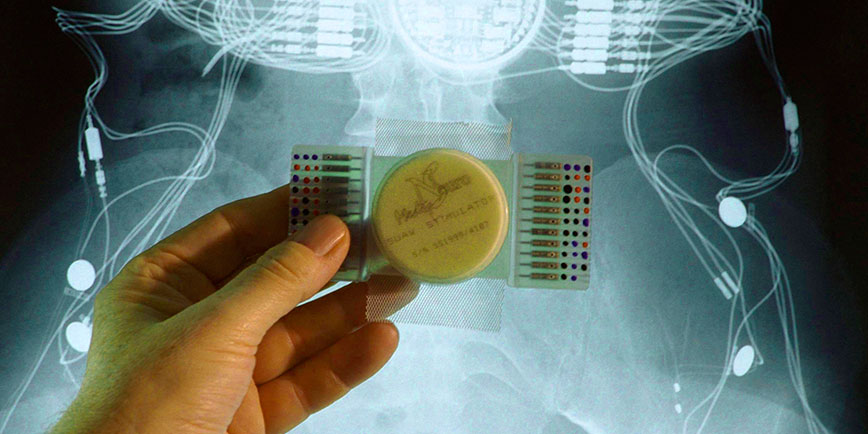

Investigadores la Universidad de California en San Francisco desarrollaron una IA capaz de convertir la actividad cerebral en texto. Por ahora, el sistema sólo detecta patrones neurales mientras una persona habla en voz alta.

“Todavía no llegamos allí, pero pensamos que puede ser la bases para una prótesis del habla”, comentó Joseph Makin, coautor del estudio publicado en Nature Neuroscience.

El grupo de científicos probar su sistema de inteligencia artificial en cuatro personas con implantes cerebrales para monitorearlas cuando tuvieran un ataque epiléptico. A los participantes se les pidió leer oraciones simples como “Tina Turner es una cantante pop” o “el oasis es un espejismo”.

A medida que hablaban, las señales cerebrales fueron alimentadas en una computadora, donde un algoritmo de machine learning se encargó de convertir los datos en una serie de números, los cuales a su vez fueron traducidos en una secuencia de palabras.

Para asegurar la validez de los números, el sistema comparó los sonidos predichos a partir de pequeñas piezas de actividad cerebral con las grabaciones de audio. Si bien el sistema presentó complicaciones al convertir palabras en oraciones coherentes, los resultados de las pruebas fueron sorprendentes.

La IA fue más precisa que transcriptores de carne y hueso, pues sólo el 3% de las oraciones se tuvieron que corregir. Mientras que, en el caso de los humanos, el margen de error alcanza el 5%.

“Si tratas de ir más allá [de las 50 oraciones usadas] la decodificación se complica más”, señaló Makin. Esto sugiere que la inteligencia artificial necesita mejoras antes de poder garantizar su confiabilidad.

Lee también: ¿Qué tanto se parece tu cerebro a la inteligencia artificial?

Otro de los problemas detectados fue que el sistema dependía de la actividad cerebral de las personas que hablaban en voz alta, lo cual podrá tener variaciones en comparación con aquellas que no pueden hablar. No obstante, esto podría ser el comienzo para posteriormente ayudar a personas que, por ejemplo, tienen parálisis, como ocurrió con Richard Marsh.

Pronto se llegará el día en que la inteligencia artificial pueda leer la mente y transformar los pensamientos en texto. Si bien esto tendrá un impacto positivo en la salud, ¿cómo se transformará el mundo de los negocios?