En busca de simplificar la vida de las personas por medio de la inteligencia artificial, Google presentó una versión mejorada de su asistente virtual impulsado por la tecnología de su chatbot Bard.

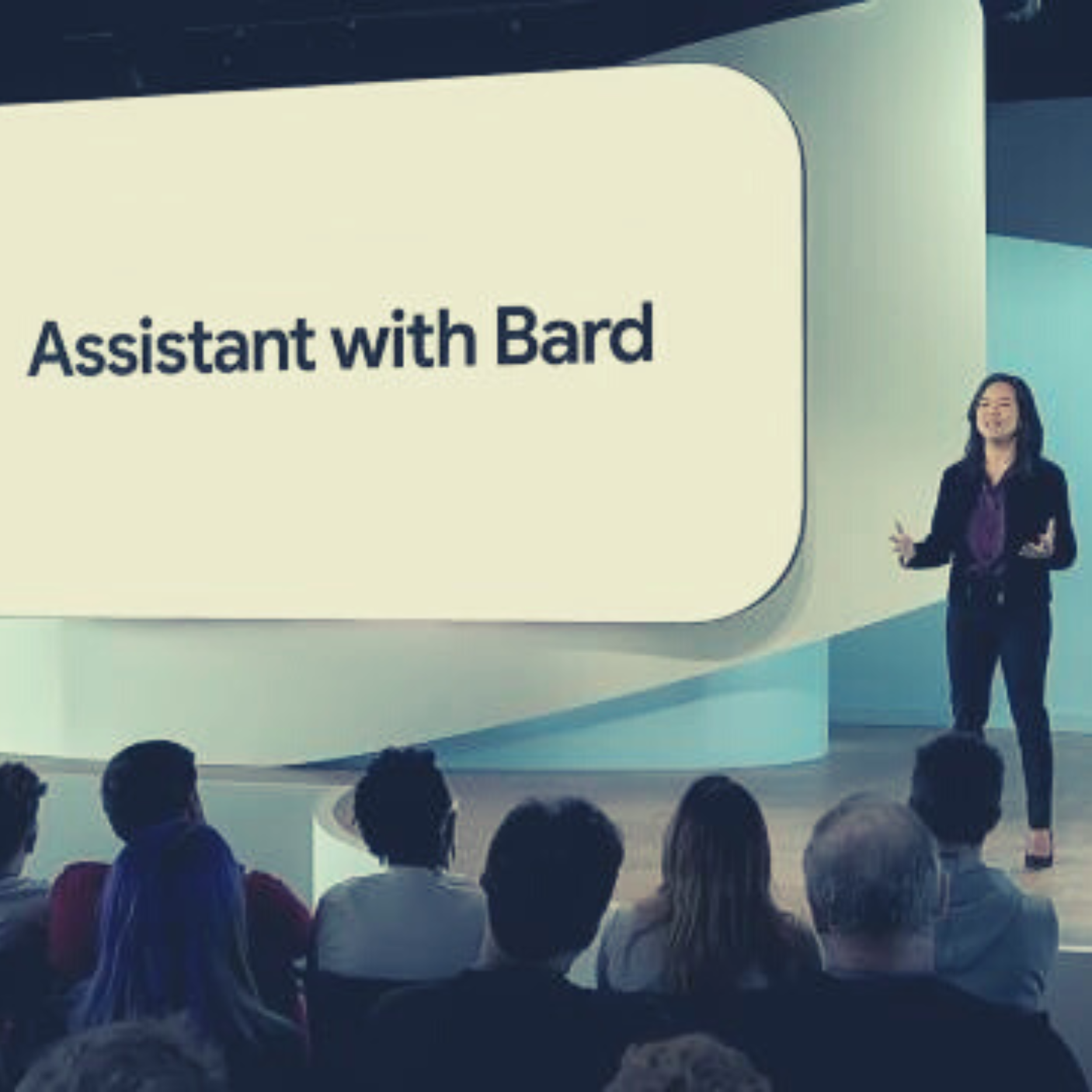

Google aprovechó la celebración del evento Made by Google, que se llevó a cabo la mañana del 4 de octubre de 2023 en Nueva York, para presentar una versión actualizada de su asistente virtual impulsada por la inteligencia artificial de Bard, llamado Assistant with Bard.

Mediante su nuevo y mejorado asistente virtual, el gigante de la tecnología está fusionando las capacidades lingüísticas, generativas y de razonamiento lógico de su chatbot de IA con la atención personalizada que ofrece la aplicación, para brindar a los usuarios nuevas funciones avanzadas y un servicio más completo.

“Durante los últimos siete años, el Asistente de Google ha ayudado a millones de personas a realizar acciones en su celular como configurar alarmas, preguntar por el tiempo o hacer llamadas rápidas con un simple “Hey, Google” a través de métodos naturales”, declaró la vicepresidenta y directora general de Assistant with Bard, Sissie Hsiao.

“Ahora, con la llegada de la IA generativa, existen un sinfín de oportunidades para ofrecer a nuestros usuarios un asistente digital que sea aún más inteligente, personalizado e intuitivo que además va más allá de los comandos por voz”, agregó la ejecutiva de Google.

Nuevas formas de interactuar con el asistente virtual de Google

Los usuarios pueden interactuar con Assistant with Bard de tres formas distintas: escribiendo sus consultas, haciéndole preguntas e indicaciones de forma hablada, o incluso pueden aprovechar la cámara para complementar sus entradas con contenido visual a través de la integración de Google Lens de Bard a la aplicación.

Según Hsiao, las personas pueden utilizar esta última función para casos como tomar fotografías de su ropa y zapatos para preguntarle al asistente como combinarlos, subir capturas de pantalla de aplicaciones para pedirle que la traduzca a código y cargar una foto para indicarle que escriba una descripción de la misma para sus redes sociales, entre muchos otros usos.

Por si fuera poco, para los dispositivos Android, han lanzado una nueva función que permite que Assistant with Bard pueda ver lo que los usuarios están viendo en su pantalla para generar respuestas a consultas basadas en esa información.

Al mantener presionado el botón de bloqueo en sus celulares, aparece una ventana emergente sobrepuesta a lo que el usuario está viendo en pantalla, lo que permite que Bard utilice dicha imagen como referencia visual, comprenda el contexto a profundidad y le ayude a los usuarios con lo que necesiten.

Por ejemplo, un usuario podría abrir Assitant with Bard mientras su cámara está apuntando a un museo y preguntarle a la IA acerca de las exposiciones actuales, así como los horarios y fechas de disponibilidad. Con tan solo ver la imagen del lugar, es capaz de realizar una investigación en segundos y ofrecer toda la información al respecto.

Nuevas capacidades para respuestas altamente personalizadas

Otra de las novedades de Assistant with Bard es que ahora tiene la capacidad de navegar a través de las distintas aplicaciones de Google, como Gmail y Drive, para generar respuestas personalizadas basadas en información presente en correos o documentos almacenados en dichas plataformas, todo esto gracias a la nueva función de Bard Extensions que fue habilitada para el chatbot hace apenas algunas semanas, a mediados de septiembre.

Durante el evento de Made by Google, Hsiao le pidió a Assistant with Bard que la pusiera al día con sus correos electrónicos más importantes y en menos de un minuto, la IA generó un reporte con los mails más relevantes que ha recibido, incluyendo un resumen de cada uno.

Además de poder navegar por las cuentas de los usuarios para generar respuestas más relevantes, personalizadas y contextualizadas, Google sugiere que las capacidades ampliadas de su asistente pueden ayudar a resolver pendientes personales como planificar viajes, crear una lista de compras, o escribir y mandar correos electrónicos, tal como lo haría un asistente humano.

La nueva versión mejorada del asistente virtual de Google llega tan solo unas semanas después de que Amazon anunciara una asociación con la startup de IA Anthropic y OpenAI lanzara nuevas funciones que le permiten a ChatGPT ver, escuchar y hablar, lo que refleja cómo la carrera por el desarrollo de la IA generativa se intensifica cada vez más y lo seguirá haciendo a medida que esta tecnología continue avanzando.