La Casa Blanca lanzó un nuevo decreto presidencial con el que busca garantizar el desarrollo responsable y seguro de los modelos de inteligencia artificial de última generación.

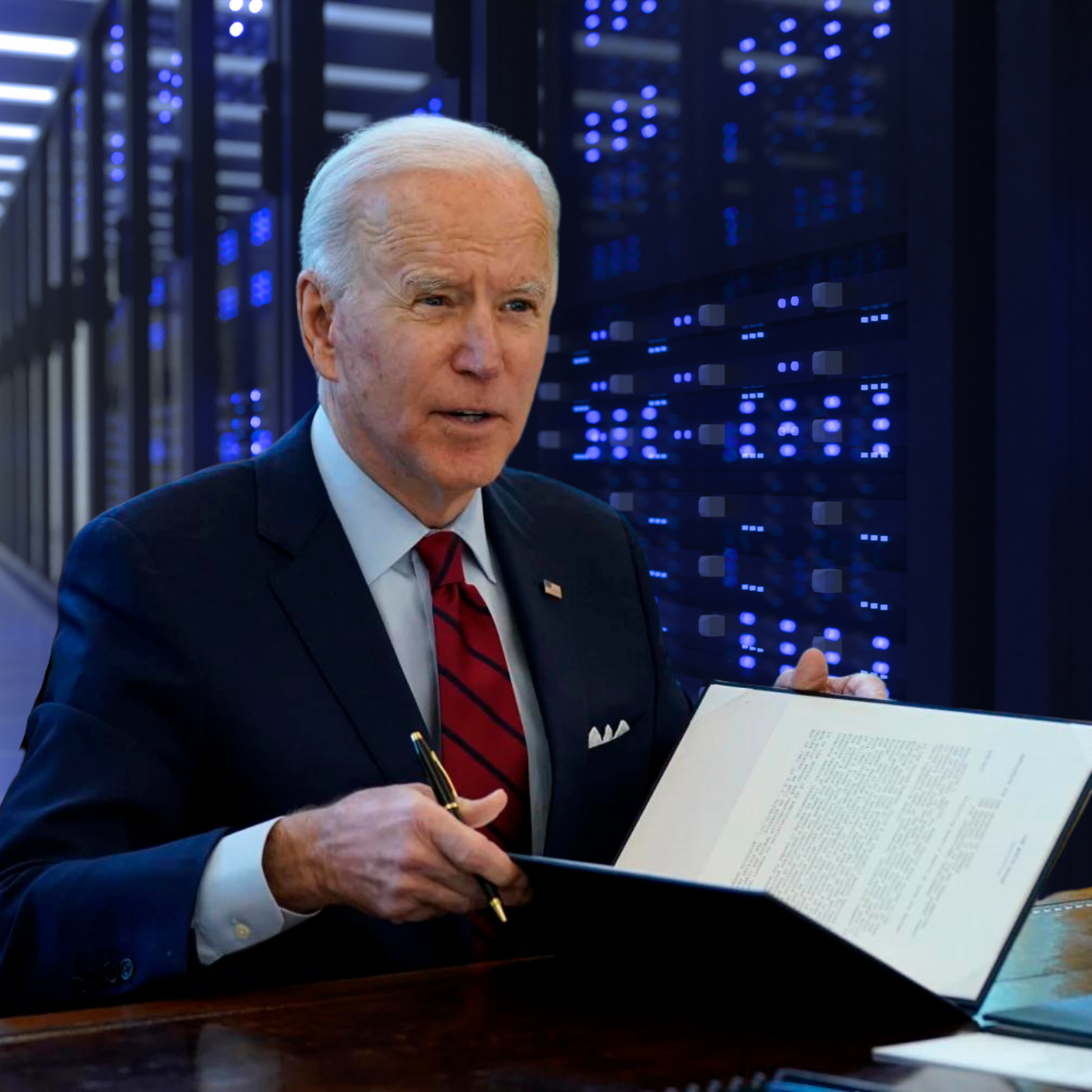

Con el objetivo de “proteger a los estadounidenses de los riesgos potenciales de los sistemas de IA”, el 30 de octubre de 2023 el presidente de los Estados Unidos, Joe Biden, emitió una nueva orden ejecutiva en la que exige la creación de nuevos estándares de seguridad para la industria, así como mayor colaboración de las principales firmas de inteligencia artificial con el gobierno, en busca de garantizar el desarrollo responsable y seguro de esta tecnología.

La orden ejecutiva de la casa blanca establece que antes de lanzar al mercado sus sistemas de inteligencia artificial, los desarrolladores deben compartir con el gobierno de Estados Unidos toda la información relevante, así como los resultados de sus pruebas de seguridad. Según la administración de Biden, esta medida “garantizará que todos los modelos de IA sean seguros y confiables antes de que las empresas los hagan públicos”.

El decreto presidencial también establece la necesidad de evaluar, no solo las pruebas de seguridad, sino también todo el proceso mediante el cual las firmas de IA recopilan y utilizan los datos para el entrenamiento de sus modelos avanzados de lenguaje.

Biden pretende atacar los riesgos de la IA trabajando en equipo

Para hacer realidad su orden ejecutiva, Biden delegó a distintas agencias gubernamentales la tarea de establecer estándares de seguridad, crear herramientas e implementar iniciativas para abordar y mitigar conjuntamente las potenciales amenazas de la inteligencia artificial.

Para empezar, exige al Instituto Nacional de Estándares y Tecnología o NIST por sus siglas en inglés, la creación de estándares rigurosos para garantizar pruebas de seguridad exhaustivas a los modelos de IA antes de su divulgación al público. Por su parte, el Departamento de Seguridad Nacional deberá aplicar los mismos estándares creados por el NIST a la infraestructura crítica de los modelos de IA para evaluar su seguridad y funcionamiento.

Por otro lado, el presidente decretó que los departamentos de Energía y Seguridad Nacional se encargarán de evaluar los riesgos químicos, biológicos, radiológicos, nucleares y de ciberseguridad que representan los sistemas de IA.

Mientras tanto, el Departamento de Comercio desarrollará una solución tecnológica para la detección de contenidos generados por IA, así como una marca de agua para etiquetar claramente esta misma clase de artículos e imágenes, con el fin de que los estadounidenses puedan utilizar estas herramientas para detectar y prevenir fraudes impulsados por el mal uso de la inteligencia artificial.

“En conjunto, estas son las acciones más sólidas que cualquier gobierno del mundo haya tomado antes para avanzar en el campo de la seguridad de la inteligencia artificial”, comentó el subjefe de gabinete de la Casa Blanca, Bruce Reed, mediante un comunicado respecto a las nuevas iniciativas anunciadas en la orden ejecutiva.

Un paso más cerca de la regulación de la IA

La orden ejecutiva presentada por Biden es producto de una serie de medidas que la Casa Blanca ha realizado en los últimos meses para promover el uso responsable de la inteligencia artificial. En diciembre del 2022, el gobierno estadounidense presentó una Declaración de derechos de IA en la que establecía los usos adecuados de esta tecnología, así como un conjunto de medidas de seguridad que los desarrolladores de modelos de IA deben acatar.

Posteriormente, en julio del 2023, la vicepresidenta Kamala Harris se reunió con los líderes de las principales compañías tecnológicas, incluyendo Google, Microsoft, OpenAI, Amazon, Anthropic y Meta para discutir cuestiones relacionadas con las herramientas emergentes de inteligencia artificial.

En aquella ocasión los gigantes de la industria se comprometieron voluntariamente a una serie de acuerdos con el gobierno de Biden con el fin de garantizar el desarrollo seguro y responsable de la IA, en los cuales se basó el presidente para lanzar su más reciente decreto.

La nueva orden ejecutiva representa un importante paso hacia la creación de estándares y regulaciones oficiales en torno al desarrollo de la inteligencia artificial, sin embargo, cabe recalcar que una orden ejecutiva no es una ley permanente, solo dura mientras el presidente que la decreta está en función.

A pesar de lo anterior, la administración de Biden confía plenamente en que la orden impulsará a los legisladores a aprobar las leyes para regular a la inteligencia artificial antes de fin de año, previo a la finalización de su gobierno.